谷歌购物发布新功能,利用人工智能为不同体型的用户体验虚拟穿衣效果

近日,据海外媒体报道,Google公司发布了针对其购物搜索的全新功能,新的功能旨在帮助用户更详细地搜索喜欢的衣服,并能更好地想象不同体型的用户的穿衣效果。

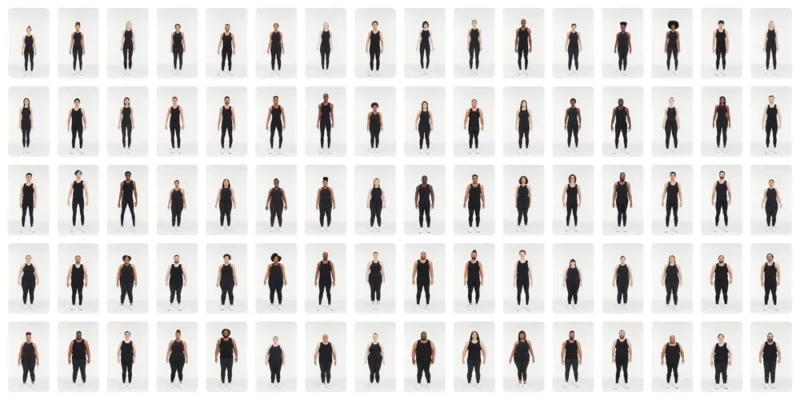

目前,这项功能将首先在美国市场发布,新功能能够真实地展示一件衣服在真人模特身上的效果。这些模特有不同的肤色、种族、发型和体型,尺码从XXS到4XL不等,以帮助用户了解一件衣服穿在和自己相似的体型上是什么样子。

据报道,目前只有H&M、Anthropologie、Everlane和Loft这几个品牌的女装可以进行虚拟试穿体验。Google公司表示,今年晚些时候,一些男装上衣和其他服装也将推出。其援引自己的购物数据称,59%的网上购物者对购买的衣服感到失望,因为他们希望衣服穿在自己身上看起来不一样,42%的人觉得网上的服装模特不能代表自己。

据报道,新的Google Shopping虚拟试穿体验使用了基于扩散(diffusion-based)的生成式人工智能模型,该模型通过向图像(本质上是随机像素)添加高斯噪声来训练,然后模型学习如何去除高斯噪声以生成逼真的图像。这一过程使Google的人工智能模型能够真实地描绘出一件衣服在不同型号的可用范围内是如何起皱、褶皱、折叠、粘着和拉伸的,而不管它们处于什么角度或姿势。需要明确的是,Google Shopping的模型并不是人工智能生成的,人工智能只是用来围绕这些人体模型的图像来塑造服装。

除了推出上述新功能外,Google Shopping也发布了新的过滤器,这一功能旨在帮助用户找到他们想要的东西,比如一件相似但更便宜的衬衫或夹克,但图案不同。机器学习和视觉匹配算法允许用户优化各种在线服装商店的颜色、风格和图案等输入,以找到最符合他们要求的商品。这项功能现在可以在Google Shopping的产品列表中使用,同样仅限于上衣,Google公司还没有提到这一功能什么时候会扩展到其他类型的服装。

延伸阅读:

Powered by Froala Editor