OpenAI首届开发者大会召开,发布GPT-4 Turbo和GPT商店,用户甚至可以创建自定义的ChatGPT

北京时间11月7日凌晨,人工智能公司OpenAI在旧金山召开了其首届开发者大会。在此次大会上,OpenAI公布了一系列人工智能工具更新,包括开发人员可以创建自定义版本的ChatGPT。另外,OpenAI还发布了一个数字商店,研究降低了开发者在其平台上使用OpenAI产品的使用费用。

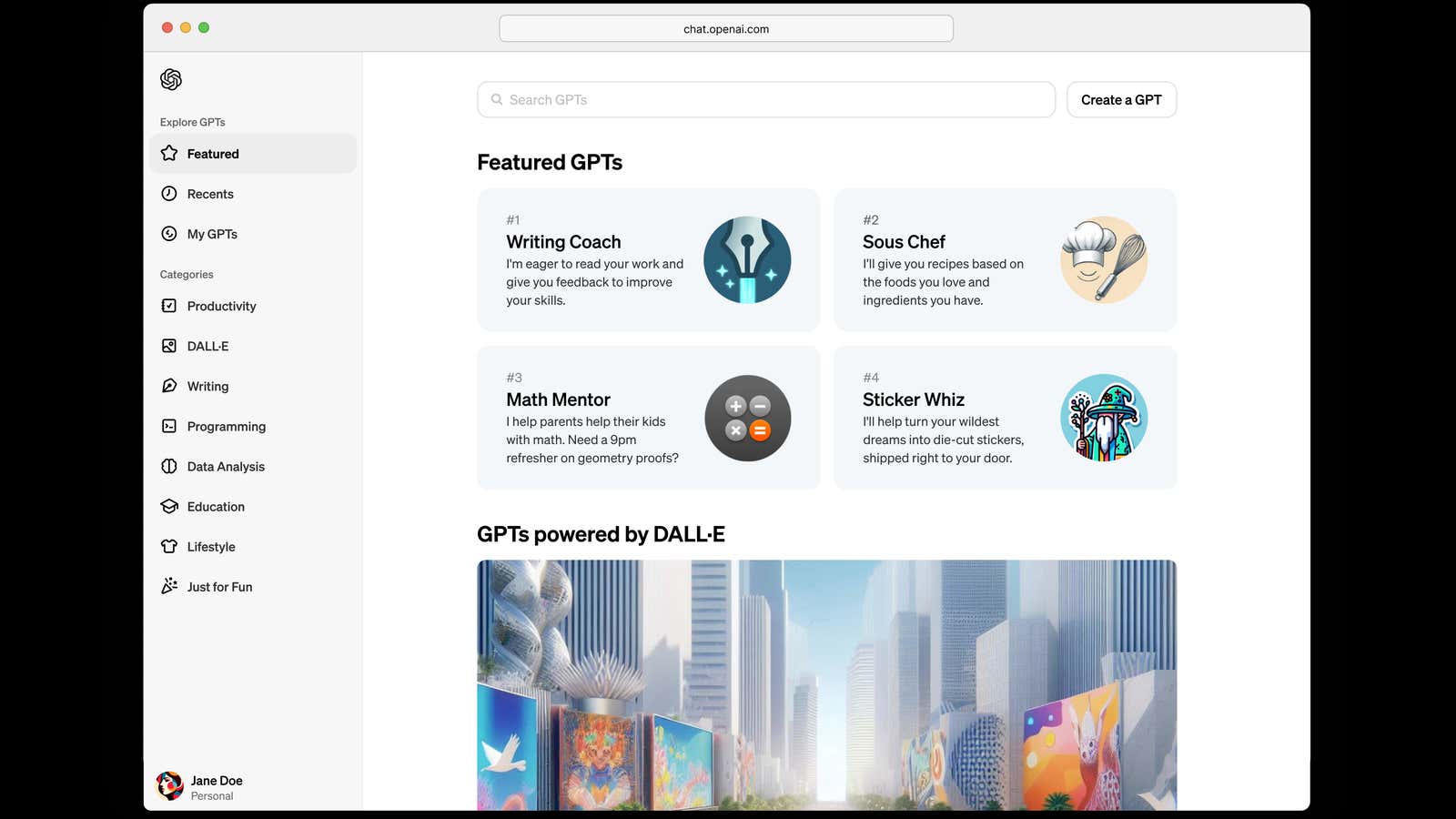

GPT Store

OpenAI公司首席执行官Sam Altman表示,目前有200万开发者在使用其平台,约90%的财富500强企业在公司内部使用其工具。目前,OpenAI公司拥有1亿活跃用户。

根据OpenAI公司官网介绍,其主要的功能更新包括:

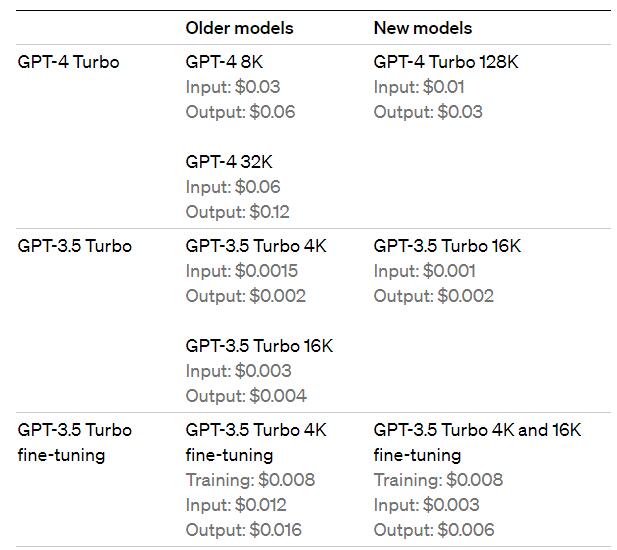

- 新的GPT-4 Turbo模型,功能更强大也更便宜,支持128K上下文长度;

- 新的助手API(Assistants API),使开发人员更容易构建自己的辅助AI应用程序;

- 平台中新的多模态功能,包括视觉、图像生成(DALL·e3)和文本到语音(TTS);

关于GPT-4 Turbo,根据OpenAI公司官网介绍,它有一个128k的上下文长度,因此它可以在一个提示符中容纳相当于300多页的文本。OpenAI还优化了其性能,能够以比GPT-4便宜3倍的价格提供GPT-4 Turbo的输入代币(input tokens),并以比GPT-4便宜2倍的价格提供输出代币(output tokens)。

所有付费的开发人员现在都可以通过在API中通过GPT-4 -1106预览版来试用GPT-4 Turbo,并计划在未来几周内发布稳定就绪的模型。

另外,OpenAI也对函数调用功能进行了更新。函数调用允许你向模型描述应用程序或外部API的函数,并让模型智能地选择输出一个包含参数的JSON对象来调用这些函数。新的更新包括在一条消息中调用多个函数的能力:用户可以发送一条消息请求多个操作,例如“打开车窗并关闭空调”(open the car window and turn off the A/C),这在以前需要与模型进行多次往返。另外还提高了函数调用的准确性:GPT-4 Turbo更有可能返回正确的函数参数。

改进指令跟随和JSON模式。GPT-4 Turbo在需要仔细遵循指令的任务上比以前的模型表现得更好,例如生成特定的格式(例如,“始终以XML响应”)。它还支持OpenAI的新JSON模式,该模式确保模型将使用有效的JSON进行响应。新的API参数response_format使模型能够约束其输出,以生成语法正确的JSON对象。JSON模式对于开发人员在函数调用之外的聊天完成API中生成JSON非常有用。

可重复输出和对数概率的改进。新的seed参数通过使模型在大多数情况下返回一致的完成结果来实现可重复的输出。这个beta特性对于用例很有用,比如重放调试请求、编写更全面的单元测试以及常见的对模型行为有更高程度的控制。在接下来的几周内,OpenAI还将推出一个功能,返回由GPT-4 Turbo和GPT-3.5 Turbo生成的最有可能输出令牌的日志概率,这将有助于在搜索体验中构建自动补全等功能。

除了GPT-4 Turbo,OpenAI还发布了一个新版本的GPT-3.5 Turbo,默认支持16K上下文窗口。新的GPT-3.5 Turbo支持改进的指令跟随、JSON模式和并行函数调用。例如,在OpenAI的内部评估显示,在完成生成JSON、XML和YAML等任务后,GPT-3.5 Turbo提升了38%。开发人员可以通过在API中调用GPT-3.5-Turbo-1106来访问这个新模型。

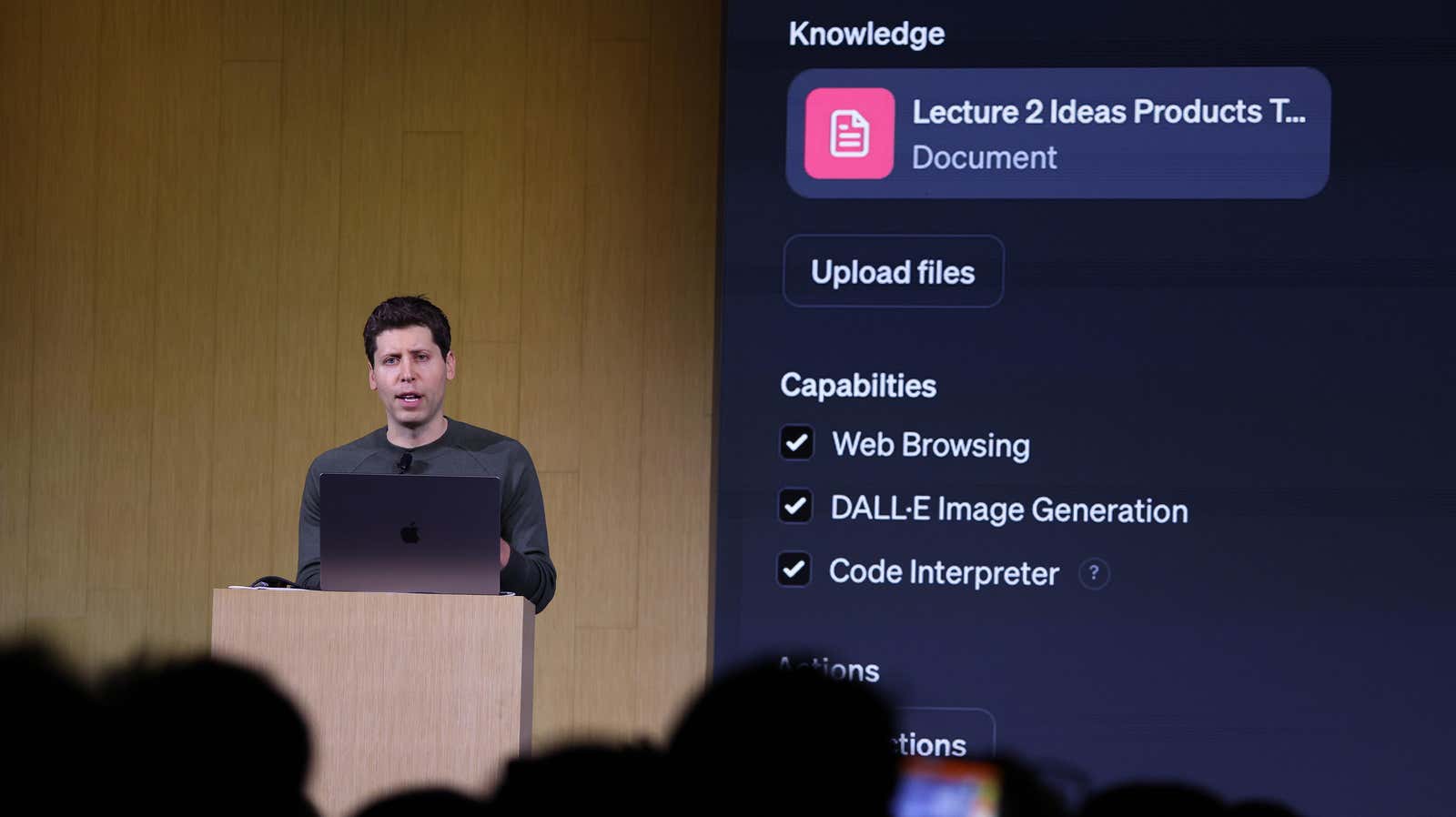

新的助手API(Assistants API)。这是OpenAI帮助开发人员在他们自己的应用程序中构建类似代理的体验的第一步。助手是一种专门设计的人工智能,它有特定的指令,利用额外的知识,可以调用模型和工具来执行任务。新的助手API提供了新的功能,如代码解释器和检索,以及函数调用来处理许多繁重的工作,使你能够构建高质量的人工智能应用程序。

新的助手API是为灵活性而设计的,用例包括基于自然语言的数据分析应用程序、编码助手、人工智能驱动的度假计划、声控DJ、智能视觉画布等。助手API建立在支持新GPTs产品的相同功能之上,这些功能包括:自定义指令和工具,如代码解释器、检索和函数调用。

这个API引入的一个关键变化是持久和无限长的线程,这允许开发人员将线程状态管理交给OpenAI,并绕过上下文窗口约束。使用助手API,你只需将每条新消息添加到现有线程中。

助理还可以根据需要调用新的工具,包括:

- 代码解释器(Code Interpreter):在沙盒执行环境中编写和运行Python代码,可以生成图形和图表,并处理具有不同数据和格式的文件。它允许你的助手迭代地运行代码,以解决具有挑战性的代码和数学问题,以及更多;

- 检索(Retrieval):使用OpenAI模型之外的知识增强助手,例如专有领域数据、产品信息或用户提供的文档。这意味着你不需要为文档计算和存储嵌入,也不需要实现分块和搜索算法。助手API根据在ChatGPT中构建知识检索的经验,优化了要使用的检索技术;

- 函数调用(Function calling):使助手能够调用你定义的函数,并将函数响应合并到其消息中;

与平台的其他部分一样,传递给OpenAI API的数据和文件永远不会用来训练OpenAI的模型,开发人员可以在他们认为合适的时候删除数据。

GPT-4 Turbo可以在Chat Completions API中接受图像作为输入,支持生成标题、详细分析真实世界图像和阅读带有数字的文档等用例。例如,BeMyEyes使用这项技术来帮助盲人或视力障碍人士完成日常生活中的各种任务,如识别产品或逛商店等。开发人员可以通过在API中使用gpt-4-vision-preview来使用这项功能。OpenAI计划推出对主要GPT-4 Turbo模型的视觉支持,作为其稳定版本的一部分。定价取决于输入图像的大小。例如,将具有1080×1080像素的图像传递给GPT-4 Turbo需要花费0.00765美元。

开发人员现在可以通过图像API将DALL - E -3指定为模型,将DALL·E -3直接集成到他们的应用和产品中。像Snap、可口可乐和Shutterstock这样的公司已经使用DALL·E 3为他们的客户和活动生成图像和设计。与之前版本的DALL·E类似,该API集成了内置的审核功能,以帮助开发人员保护其应用程序免遭滥用。每张生成的图像的收费价格为0.04美元起步。

开发人员现在还可以通过文本到语音(text-to-speech,TTS)API从文本生成真实人类质量的语音。OpenAI的新的TTS模型提供六种预设声音可供选择和两种模型变体,TTS -1和TTS -1-hd。TTS针对实时用例进行了优化,TTS -1-hd针对质量进行了优化。起价为每输入1000个字符0.015美元。

延伸阅读:

- GPT-4发布更新,支持一站式处理多个分析和生成任务

- OpenAI发布最新版文生图AI生成器DALL·E 3,将和ChatGPT集成

- OpenAI发布ChatGPT企业版

- OpenAI首笔收购的Global Illumination,后者做了一款开源沙盒大型多人在线角色扮演游戏

- 传OpenAI计划推出一个在线市场,开发者可以交易自己的人工智能模型

- OpenAI发布Shap-E模型,文本提示即可转换成3D对象

- OpenAI将发布企业版订阅服务ChatGPT Business

- OpenAI旗下基金领投人形机器人公司1X,后者获将机器人用于安全领域

- OpenAI发布AI语言模型最新版本GPT-4

- ChatGPT重磅升级,将支持语音输入输出和图像识别对话能力

Powered by Froala Editor